De nuevo el mundo se divide en dos: quienes apoyan la inteligencia artificial (IA) y quienes le temen. Dicha división es regla: el desarrollo de la imprenta, la radiación como fuente de energía, recuérdense los casos de Chernóbil (Rusia) en 1986 y el de Fukushima (Japón) en 2011, o el exceso en el uso de la tecnología médica en enfermos que no la requieren. La IA de nuevo es objeto de desavenencias: a sus aduladores y seguidores les importa un bledo la opinión de quienes la consideran un instrumento cuyas consecuencias negativas aún no son predecibles.

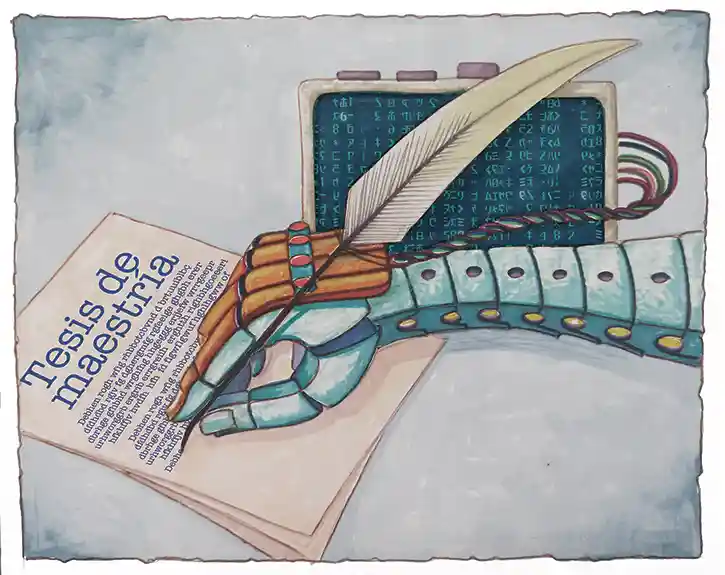

Pocos días atrás una profesora me explicaba que para ella era fácil discernir cuántos alumnos entregaban sus trabajos usando la inteligencia artificial y cuántos los habían escrito gracias a la búsqueda de información. La lección es obvia: si la IA resuelve tareas, el trabajo académico disminuye, la curiosidad decae y el esfuerzo intelectual, en este caso de jóvenes, merma; su afán de investigar y su capacidad de dudar y preguntar se esfuma. Malos agüeros: nunca será suficiente insistir, sobre todo en la juventud, acerca del valor de la duda y del conocimiento acumulado durante siglos.

El uso de la IA, así como su instrumento ChatGPT, le permite a quien la utilice escribir en otros lenguajes pero, a la vez, si es usada sin fundamentos éticos, puede diseminar escritos copiados o mezclas de ellos. Los expertos en IA se preguntan si es correcto utilizarla para valorar la posible publicación de trabajos científicos. El problema es mayúsculo: ¿dónde queda el valor y la opinión de quienes por su experiencia han trabajado durante años como revisores? Revistas médicas de gran impacto y presencia como la británica The Lancet, publicada desde 1823, han reiterado los posibles daños al sustituir el conocimiento humano por los dictámenes de la IA. Dicho temor y las aseveraciones de la profesora muestran las repercusiones negativas de la IA: ¿desplazará al ser humano?, ¿nos convertiremos en apéndices de nuestras creaciones?

La IA, hasta ahora —quizás en el futuro se nos informe que tiene alma y sentimientos— no tiene la capacidad de competir con la visión humana. La formación de las personas conlleva múltiples factores: casa, escuela, amigos, trabajo, noticias, perspectivas presentes y futuras y, entre otras, historia. La suma previa suma vida, experiencia, conocimiento, contacto humano. La IA no tiene ni tendrá dichas facultades.

Los doctores y editores de revistas médicas, preocupados por el avance —lo denominaré amenaza de la IA— han demostrado que los trabajos revisados por dicho utensilio son superficiales e incompletos. La experiencia acumulada por investigadores y académicos no puede reemplazarse por herramientas creadas por el ser humano. Insisto, me repito, la humanidad corre el peligro, cada vez más, de convertirse en instrumento de nuestras creaciones. Terrible perspectiva.

Investigadores independientes han demostrado que herramientas como GPT-4 pueden perpetuar sesgos raciales y de género en relación con la salud. Dicho instrumento no tuvo la capacidad de definir la diversidad y diferencia de problemas médicos entre hombres y mujeres. Debido a lo anterior, revistas médicas de prestigio internacional han exigido a los posibles autores que declaren si utilizaron IA para elaborar su trabajo; otras la han prohibido en forma absoluta. Algunas revistas han encontrado que las revisiones de trabajos hechas por IA son superficiales, amén de su imposibilidad para recibir retroalimentación.

Si bien es bienvenida la fuerza creadora del ser humano, es ético y necesario repetirlo: la investigación, de cualquier tipo, debe asumir que la ciencia debe estar al servicio de la humanidad. De no ser así, continuaremos transformándonos en los instrumentos de nuestros instrumentos.

Arnoldo Kraus

Profesor en la Facultad de Medicina de la UNAM. Miembro del Colegio de Bioética A. C. Publica cada semana en El Universal y en nexos la columna Bioéticas.